Como usar o Ollama localmente com o VS Code. IA (Inteligência artifical)

Quer usar inteligência artificial localmente no seu computador sem depender da nuvem? Com o Ollama e o Visual Studio Code (VS Code), você pode rodar modelos de linguagem como o Llama 3 e o Qwen 2.5 Coder diretamente no Windows.

1. Baixar e instalar o Ollama

Primeiro, faça o download do Ollama diretamente no site oficial:

https://ollama.com/download

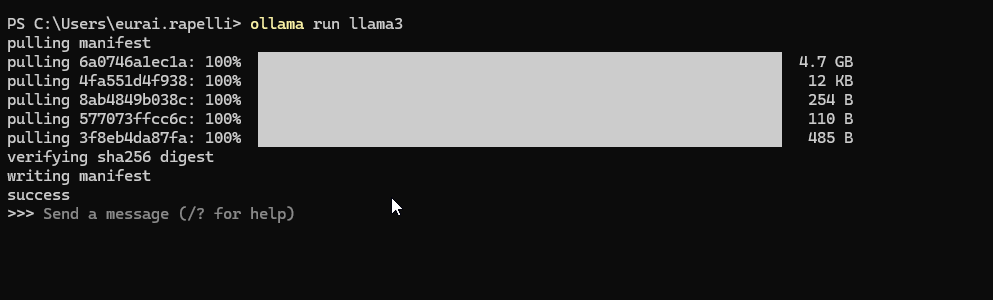

2. Baixar os modelos de IA

Depois de instalar o Ollama, abra o terminal do Windows e execute os seguintes comandos para baixar os modelos desejados:

ollama pull llama3.1:8b

ollama pull qwen2.5-coder:1.5b-base

ollama pull nomic-embed-text:latest

3. Verificar o Ollama em execução

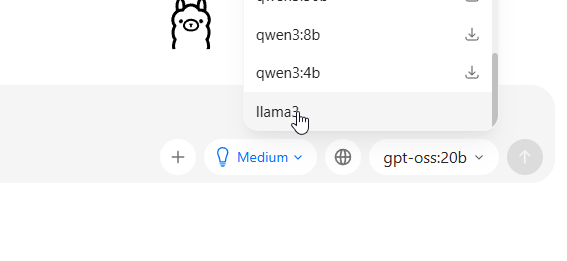

Abra o aplicativo Ollama e verifique se os modelos foram baixados corretamente.

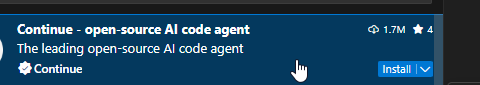

4. Instalar a extensão do Ollama no VS Code

No VS Code, abra a aba de extensões (Ctrl + Shift + X) e procure por Continue (ou “Ollama VS Code”). Clique em Instalar.

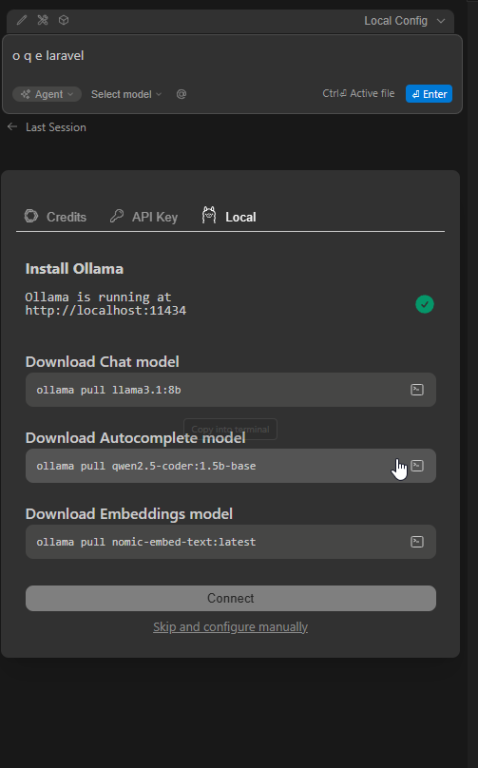

5. Configurar o Ollama no VS Code

Após instalar a extensão, configure a URL e o modelo local do Ollama. Na maioria dos casos, as configurações padrão já são:

- URL: http://localhost:11434

- Modelo: llama3.1:8b

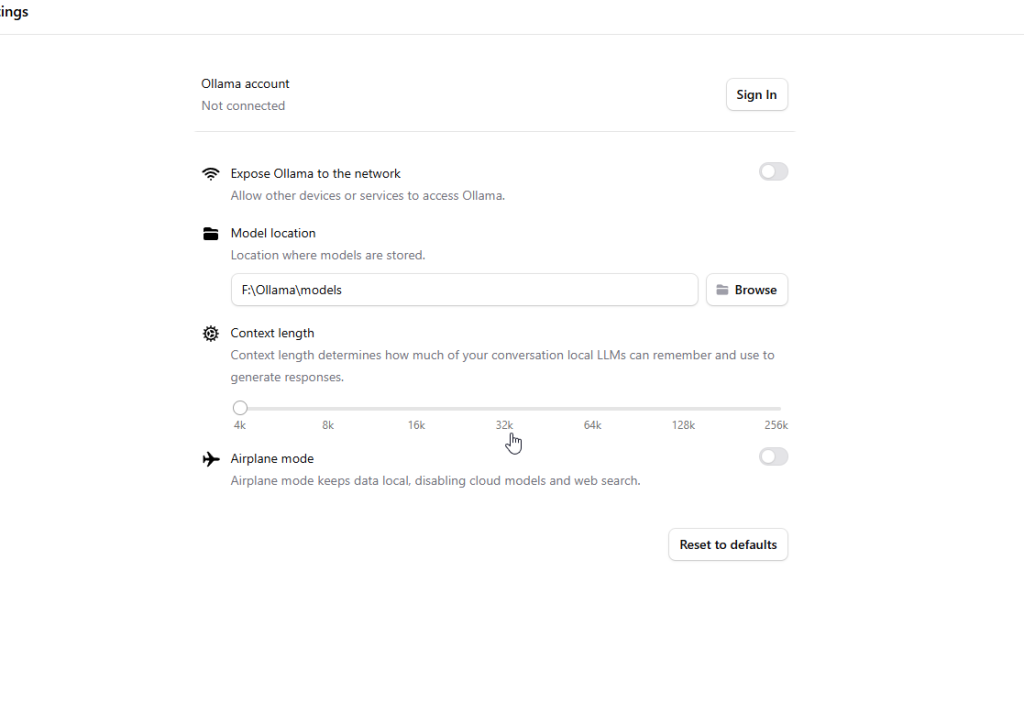

Configurar o caminho

Clicar com o botão direito no ícone do lado do relógio > settings.

Outro modelos

ollama pull jmorgan/grok:latest

Dica extra

Se você quiser usar o Ollama com outras ferramentas ou IDEs, basta manter o servidor local ativo. Isso permite integrar IA generativa em qualquer fluxo de trabalho.

Gostou do tutorial? Compartilhe com seus amigos e deixe um comentário abaixo! 😎

Um abraço e até a próxima!